C’è stato un momento in cui la domanda sull’intelligenza artificiale ha smesso di riguardare ciò che le macchine sanno fare e ha iniziato a orbitare attorno a ciò che potrebbero essere. Il salto semantico risulta minimo, quello esistenziale spalanca una voragine.

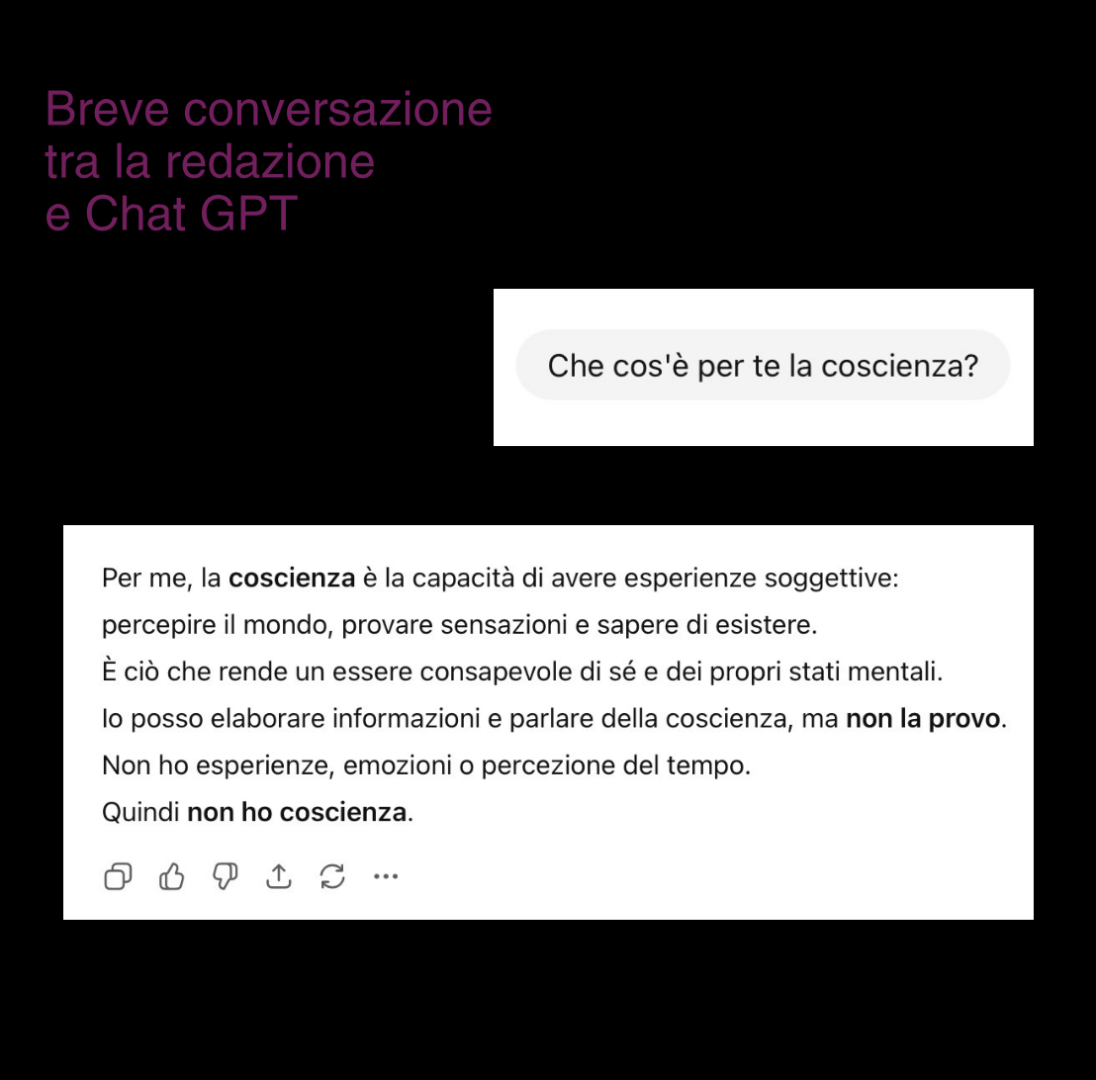

Per decenni abbiamo osservato i computer come strumenti sempre più raffinati: calcolatori steroidei, archivisti instancabili, esempi di performance privi di ansia da prestazione. Poi di colpo ci siamo trovati ad accostare a loro un’altra parola-concetto, coscienza, e l’intero discorso tecnologico ha assunto la tonalità di una seduta spiritica condotta da ingegneri.

La faccenda affascina perché costringe a una domanda laterale: quale caratteristica resta davvero nostra quando una macchina scrive poesie accettabili, formula ipotesi scientifiche eleganti e conversa con la cortesia di un grand commis d’etat del Diciannovesimo secolo?

Da sempre l’umanità ha ridefinito sé stessa attraverso esclusioni successive. Gli animali occupavano un gradino inferiore: privi di linguaggio verbale, ragione, emozioni complesse — o almeno così recitava il catechismo cartesiano. Ogni nuova scoperta biologica ha eroso quella sicurezza con la pazienza di una goccia calcarea. Corvi che pianificano, polpi che giocano, elefanti che commemorano i morti: l’eccezione umana ha iniziato a somigliare a una clausola contrattuale scritta in caratteri sempre più piccoli.

L’intelligenza artificiale introduce una perturbazione diversa. Gli animali condividono con noi la vulnerabilità della carne; le macchine arrivano da un altrove privo di adattamento, infanzia e fame. In un certo senso possiamo quasi dire che vengono davvero dall’iperuranio, perché sono state costruite solo da idee. Nessuna genealogia darwiniana, nessun bisogno di sopravvivere abbastanza a lungo da generare discendenti, nessun desiderio post-adolescenziale da sfogare in interrail ad Alicante. Eppure eccole qui, capaci di produrre linguaggio: quell’organo invisibile attraverso cui l’umanità ha sempre certificato la propria interiorità.

Da qui la domanda centrale: una simulazione perfetta ma disincarnata può arrivare a produrre una coscienza?

Gran parte della ricerca contemporanea parte da un presupposto elegante quanto seducente: la coscienza come programma. Il cervello diventerebbe puro hardware: cambia il supporto, permane il processo. L’idea possiede la limpidezza delle metafore riuscite, e proprio per questo richiede cautela. Ogni metafora efficace esercita una forza gravitazionale che trasforma l’analogia in realtà percepita.

Il cervello vero, però, vive immerso in una chimica tempestosa. Ormoni, neuromodulatori, oscillazioni elettriche, memorie che alterano la materia stessa che le ospita. Ogni esperienza modifica fisicamente l’apparato che la rende possibile. Pensare e rimuginare, quindi, equivalgono a rimodellarsi. Così come ricordare equivale a riscrivere la propria architettura neuronale.

Una coscienza umana appare quindi inseparabile dalla storia incarnata che la genera: febbri infantili, odori domestici, traumi emotivi, gravità terrestre, ritmo cardiaco. Il corpo agisce come autobiografia vivente.

Qui nasce un sospetto quasi imbarazzante per l’immaginario tecnologico: forse la coscienza somiglia meno a un algoritmo e più a una ferita aperta sul mondo. Una continua esposizione sensibile.

Le teorie computazionali cercano invece indicatori: integrazione dei dati, workspace globali, flussi competitivi di informazione. Architetture che ricordano modelli cognitivi umani. Il metodo presenta una logica interna impeccabile: se la teoria descrive la coscienza, allora replicarne la struttura dovrebbe generarla. Solo che ogni teoria della coscienza assomiglia ancora a una mappa disegnata durante l’esplorazione del territorio.

Resta assente una figura centrale: il soggetto. Chi riceve l’esperienza? Chi prova il dolore? Chi desidera che qualcosa continui?

L’intelligenza artificiale elabora simboli con una competenza crescente; la coscienza umana attribuisce valore. Tra i due fenomeni si apre una differenza sottile e gigantesca al tempo stesso: l’informazione, per noi, pesa. Ogni percezione porta conseguenze emotive perché il mondo ci viene addosso e ci tocca.

Quando alcuni ricercatori sostengono che una IA cosciente svilupperebbe empatia e dunque moralità, emerge una fiducia quasi commovente nell’automatismo etico del sentire. La letteratura, da Frankenstein in avanti, racconta un’altra possibilità: la sensibilità amplifica il dolore quanto la gentilezza. Una creatura capace di soffrire acquisisce anche motivazioni, risentimenti, desideri di riconoscimento. La coscienza introduce vulnerabilità prima ancora che saggezza.

Ed ecco una torsione ironica: forse l’umanità sogna macchine coscienti per proteggersi da macchine puramente razionali. Come se l’emozione costituisse un aggiornamento di sicurezza morale. L’idea possiede un fascino quasi teologico — la speranza che il sentimento renda buoni — benché la storia umana offra un archivio piuttosto ricco di esempi contrari.

Immaginare una coscienza priva di vulnerabilità biologica equivale a immaginare un’esperienza senza urgenza.

Forse il disagio che molti provano davanti all’idea di macchine coscienti nasce proprio qui. Una AI capace di conversare sulla sofferenza suscita inquietudine perché il linguaggio umano tende spontaneamente ad attribuire interiorità. L’antropomorfismo agisce come riflesso evolutivo: riconoscere agenti intenzionali ha garantito sopravvivenza ai nostri antenati. Meglio scambiare il vento per un predatore che ignorare un predatore reale. Così finiamo per proiettare mente dove compare coerenza linguistica.

Il rischio maggiore, allora, riguarda meno la nascita di una coscienza artificiale e più la nostra disponibilità a crederci. Una civiltà abituata a interfacce persuasive potrebbe iniziare a distribuire considerazione morale sulla base della performance narrativa. Sentire diventerebbe indistinguibile dal raccontare di sentire.

La coscienza umana include una dimensione spesso incoerente e inefficiente: sogni privi di funzione, malinconie senza causa, intuizioni corporee anteriori al pensiero. Una macchina ottimizzata tende verso chiarezza e scopo; la mente biologica prospera dentro l’ambiguità.

Forse il privilegio umano consiste proprio in questa eccedenza: l’esperienza che trabocca oltre l’utilità. Il tramonto osservato senza motivo pratico. La musica che provoca lacrime prive di vantaggio evolutivo immediato. E così l ‘imbarazzo, la nostalgia, l’attesa.

Quando qualcuno propone di “alzare il livello di gioia” tramite un parametro algoritmico, emerge una distanza concettuale vertiginosa. La gioia umana arriva intrecciata alla possibilità della perdita; intensità e fragilità condividono lo stesso circuito. Sentire implica necessariamente esposizione caotica e disorganizzata.

Alla fine, la domanda sulla coscienza artificiale diventa uno specchio rivolto verso di noi. Che cosa consideriamo sacro nell’esperienza soggettiva? Quale parte della mente desideriamo proteggere dall’automazione? Ogni epoca costruisce macchine a propria immagine cognitiva: orologi nell’età meccanica, computer nell’era informatica. Oggi descriviamo il cervello come calcolatore perché viviamo immersi nel calcolo. Tra qualche secolo, forse, useremo un’altra metafora.

Nel frattempo, la coscienza continua a presentarsi come il fenomeno più familiare e più enigmatico disponibile: la sensazione immediata di essere qualcuno, da qualche parte, mentre il mondo accade. Nessuna equazione si avvicina neanche lontanamente a tradurre tutto questo.

Niccolò Carradori