La recente rivoluzione delle intelligenze artificiali generative è ormai pienamente in atto e il modo in cui produciamo musica è destinato a cambiare in maniera radicale. Quando software come Suno hanno iniziato ad affacciarsi sul mercato, la reazione predominante è stata di timore: molti hanno ipotizzato che il lavoro del musicista potesse diventare progressivamente obsoleto.

Accanto a queste posizioni più allarmiste, tuttavia, si è fatta strada fin da subito una lettura diversa. Secondo altri le intelligenze artificiali generative non avrebbero sostituito il produttore musicale, ma avrebbero assunto un ruolo ancillare, configurandosi piuttosto come una nuova classe di strumenti a disposizione del musicista. In questo scenario il produttore rimane una figura centrale, ma dispone di tecnologie capaci di semplificare alcune fasi del lavoro creativo o di offrire un appoggio nei momenti di stallo compositivo.

Quel futuro è già qui. E, almeno per ora, la storia sembra dare ragione ai secondi, visto che anche il software della Ableton (Live) potrebbe integrare in maniera strutturale le AI generative a partire dalla prossima versione.

Ma andiamo con ordine. Di Suno si è già parlato moltissimo: quasi tutti abbiamo avuto modo di sperimentare la sua capacità di generare brani in stili diversi a partire da un semplice prompt testuale, capacità che arriva perfino a musicare un testo fornito direttamente dall’utente. Nonostante queste possibilità, i brani prodotti dalla piattaforma non hanno conosciuto una vera circolazione autonoma: nella maggior parte dei casi emerge subito quella qualità artificiale, una sorta di patina senz’anima che rende l’ascolto riconoscibile e, alla lunga, poco interessante. Dove Suno ha trovato terreno fertile invece è stato nel contesto della produzione virale: canzoni-meme, parodie e nonsense pensati per accompagnare i cosiddetti video “slop” che circolano sui social.

Una delle applicazioni che sembrano riscuotere più interesse, però, non riguarda tanto la generazione completa di brani, quanto piuttosto il trasferimento di timbro. Si tratta di tecnologie capaci di trasformare un input audio, per esempio una voce, in qualcosa di diverso: una batteria, un violino, un’altra voce con caratteristiche timbriche differenti. In altre parole, non si tratta tanto di “scrivere musica al posto dell’utente”, quanto di trasformare materiale già esistente spesso registrato dallo stesso produttore.

Questo tipo di tecniche non nasce oggi. Nella ricerca musicale accademica, ad esempio, il trasferimento di timbro è oggetto di studio da anni all’interno di istituzioni come l’IRCAM di Parigi, uno dei principali centri di ricerca al mondo per la musica elettronica e l’informatica musicale. Proprio in quel contesto sono stati sviluppati sistemi basati su reti neurali come RAVE, utilizzati da compositori e sound designer per manipolare e trasformare segnali audio in tempo reale. Di queste tecnologie avevo parlato anche in un precedente articolo apparso su The Bunker.

Parallelamente, sta emergendo un’altra tendenza ancora: plugin e ambienti di produzione sempre più integrati con sistemi di intelligenza artificiale. Un esempio significativo è Co-Producer, sviluppato dalla società californiana Output e presentato nel 2025. Più che generare musica da zero, Co-Producer funziona come una sorta di assistente creativo all’interno della DAW: il plugin “ascolta” il progetto, ne analizza ritmo e armonia e suggerisce campioni compatibili da una vasta libreria sonora integrata.

Tra le sue funzioni più interessanti c’è Re-Imagine, che permette di generare variazioni potenzialmente infinite di uno stesso sample, modificandone caratteristiche ritmiche o timbriche per ottenere versioni sempre diverse. L’idea alla base è relativamente semplice: molti produttori utilizzano le stesse piattaforme di campioni (ad esempio Splice) e finiscono quindi per attingere agli stessi suoni. Il risultato è una certa omogeneizzazione delle produzioni. Strumenti come Re-Imagine tentano di rompere questo circolo, consentendo di partire da un sample noto per generare versioni alternative e più personali.

Naturalmente, si potrebbe obiettare che la ripetizione dei campioni non è sempre stata percepita come un problema. In molti casi, anzi, alcuni sample sono diventati veri e propri marcatori stilistici, contribuendo a definire interi generi musicali. Pensiamo, ad esempio, a certe drum machine nella musica house o techno, oppure ai loop vocali e alle percussioni tipiche del funk carioca e delle sue evoluzioni più recenti come il phonk brasiliano: suoni riconoscibili che diventano parte integrante dell’identità di un genere. In questo senso la standardizzazione dei campioni non è necessariamente un limite, ma può trasformarsi in un elemento di riconoscibilità culturale.

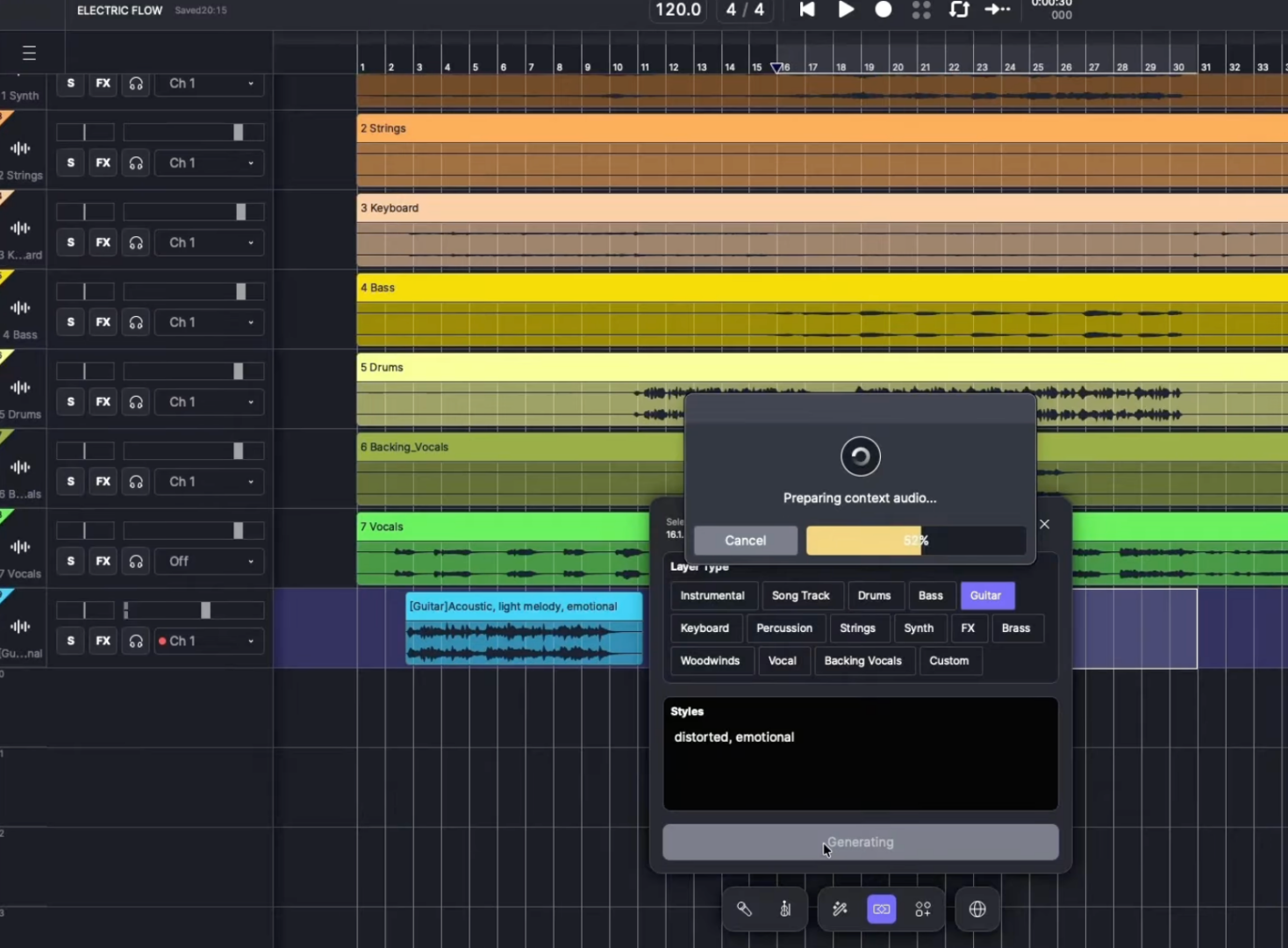

Se Co-Producer rappresenta un primo passo verso l’integrazione dell’intelligenza artificiale nella produzione musicale tradizionale, altre piattaforme sembrano spingersi ancora oltre. È il caso di ACE Studio, sviluppato proprio dalla stessa Suno AI. Qui l’intelligenza artificiale non si limita ad assistere il produttore nella ricerca di suoni, ma entra piuttosto direttamente nella fase di creazione: il sistema consente di generare parti strumentali o vocali a partire da prompt testuali, mantenendo automaticamente coerenza con parametri come bpm, tonalità e struttura della produzione. In pratica, la DAW diventa sempre più un ambiente di co-creazione tra utente e modello generativo.

È forse anche alla luce di queste trasformazioni che alcune aziende storiche del settore stanno iniziando a muoversi. Negli ultimi mesi, ad esempio, ha fatto discutere una mossa di Ableton, la società che sviluppa la celebre DAW Ableton Live. A gennaio l’azienda ha pubblicato un annuncio di lavoro per la posizione di Senior Machine Learning Research Engineer, segnale piuttosto chiaro dell’interesse verso l’integrazione di sistemi di intelligenza artificiale all’interno del proprio ecosistema software.

La notizia ha alimentato molte speculazioni nella comunità dei produttori. Se da un lato Ableton è sempre stata percepita come uno strumento fortemente orientato al controllo manuale e alla sperimentazione, dall’altro l’ingresso esplicito di competenze legate al machine learning lascia intuire che anche una piattaforma così consolidata stia iniziando a interrogarsi sul ruolo delle AI nella produzione musicale del prossimo futuro.E forse è proprio qui che si gioca la partita più interessante: non tanto nella sostituzione del musicista, quanto nella ridefinizione della figura del produttore, sempre più affiancato. O, per usare un termine ormai ricorrente, coadiuvato da un “co-producer” artificiale.

Pierluigi Fantozzi